Mikä on EU AI Act?

EU AI Act on EU:n lainsäädäntö, jolla pyritään varmistamaan, että EU:n sisällä toimivat tekoälysovellukset ovat

- hyödyllisiä kansalaisille

- niiden riskit on kartoitettu ja

- niitä seurataan koko sovelluksen elinkaaren ajan.

AI Act kategorisoi tekoälysovellukset niiden tuomien riskien mukaan kolmeen eri kategoriaan. Ensimmäiseen kuuluvat kielletyt sovellukset, jotka tekevät esim. sosiaalista pisteytystä. Kasvojen tunnistus kielletään kokonaan ko. toiminnallisuuden tuomien riskien vuoksi.

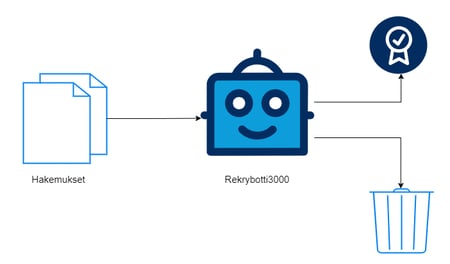

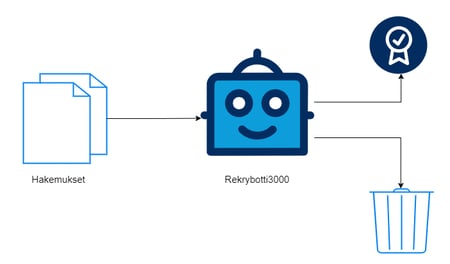

Suurin osa lainsäädännöstä keskittyy toiseen kategoriaan. Siihen kuuluvat niin sanotut korkean riskin tekoälyjärjestelmät, jotka vaikuttavat mm. ihmisten elinkeinoon ja mahdollisuuksiin tai käyttävät biometrista dataa. Esimerkkejä tämän kategorian sovelluksista ovat rekrytoinnissa avustava sovellus, joka ehdottaa hakemuksista mielestään parhaat hakijat rekrytoijalle, tai sovellus, joka tunnistaa asiakaspalvelupuheluista vihaiset soittajat.

Hakemuksia karsiva rekrybotti kuuluisi AI Actin toiseen kategoriaan, eli se katsottaisiin korkean riskin tekoälysovellukseksi.

Nämä käyttötapaukset eivät ole suoraan kiellettyjä, mutta niiden käyttöön liittyy tiettyjä vaatimuksia. Järjestelmästä täytyy toimittaa jäsenvaltion virastolle mm. sen tekninen dokumentaatio käytettävästä ja tuotettavasta datasta sekä toiminnan testauksesta ja seurannasta tuotannossa.

Suurin osa jo markkinoilla olevista tekoälysovelluksista on kuitenkin kolmannen kategorian eli matalan riskitason sovelluksia. Näihin ei tarvitse soveltaa edellä mainittuja AI Actin rajoituksia ja vaatimuksia.

Huomiota on kuitenkin syytä kiinnittää generatiiviseen tekoälyyn liittyviin pykäliin. Niissä vaaditaan kertomaan loppukäyttäjille kyseessä olevan tekoäly eikä oikea ihminen. Tämä tulee vaikuttamaan muun muassa yritysten kotisivujen asiakaspalvelubotteihin, joissa moni jo nyt käyttää generatiivista tekoälyä yleisimpiin kysymyksiin vastaamiseen ennen vierailijan yhdistämistä asiantuntijalle.

EU AI Act tuo vaatimuksia myös suurten kielimallien (esim. GPT-4) tekijöille, jotka edistävät kielimallien läpinäkyvyyttä ja niihin liittyvien systemaattisten riskien kartoittamista. Jo vuoden päästä Open AI:n ja muiden kielimallien luojien täytyy toimittaa uusien kielimallien mukana dokumentaatiota niiden koulutuksesta ja muusta toiminnasta European AI Officelle sekä lisäinformaatiota kehittäjille, jotka kielimalleja käyttävät. Avoimien kielimallien osalta näitä ei tarvitse tehdä, joten on mahdollista, että Metan strategia jakaa Llama-kielimalleja yleisölle voi olla jatkossa vielä yleisempää.

Mitä yrityksien kannattaa tehdä?

EU AI Act voidaan ajatella suurimmaksi osaksi riskianalyysin jatkumona, jossa tekoälysovelluksien toiminta käydään läpi ja tutkitaan sen käyttöön liittyviä riskejä. Jo sovelluksen ideointivaiheessa on hyvä miettiä, mitä tekoälyn käytöllä saavutetaan, kuuluuko sovellus johonkin korkean riskin kategoriaan tai mitä muita mahdollisia riskejä siihen liittyy.

Riskien hahmottelussa on hyvä huomioida, että korkeampi autonomian taso järjestelmässä tuo usein myös lisää riskejä. On hyvä pitää mielessä, että päätöksenteossa ihmisen tulee olla aina tärkeimmässä roolissa ja tekoälyn tehtävänä on helpottaa ihmisten tekemää työtä.

AI Act etenee vauhdilla ja ennen pitkää julkaistavia lopullisia säädöksiä kannattaa pitää silmällä. Me Advanialla seuraamme tarkasti AI Actin vaikutuksia tulevaisuuden tuotteisiin ja palveluihin.

Testi

Onko sinulla jo idea uudesta tekoälyä hyödyntävästä sovelluksesta? Tee testi (toteutettu Microsoft Formsilla) ja katso kuuluuko se sääntelyn piiriin!

Jos sinulla heräsi kysymyksiä AI Actista tai muusta tekoälyyn liittyvästä, ota yhteyttä! Autammehan yrityksiä luomaan kestävää arvoa teknologian älykkäällä käytöllä!